前端

scala

sqlserver

BeanMap

电子学会2022年9月考试

二分法

CVE-2013-4547

关联数组

算法的时间复杂度和空间复杂度

HuggingFace

File的构造方法

debian

光照度传感器

lstm

QScintilla

KKT条件

界面开发

高等数学

代码加壳

图像分类

信息论

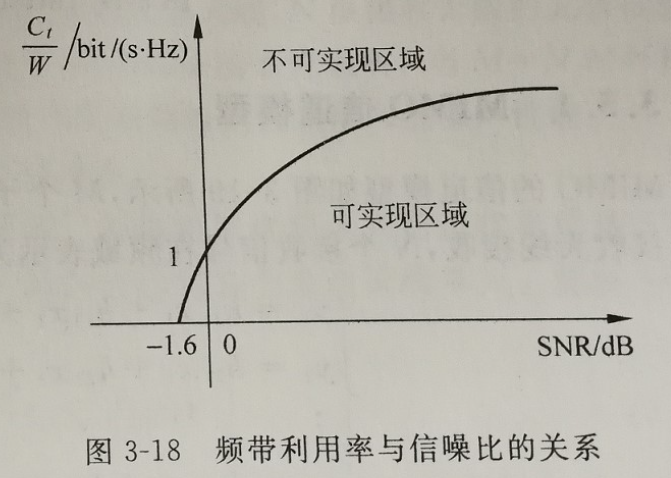

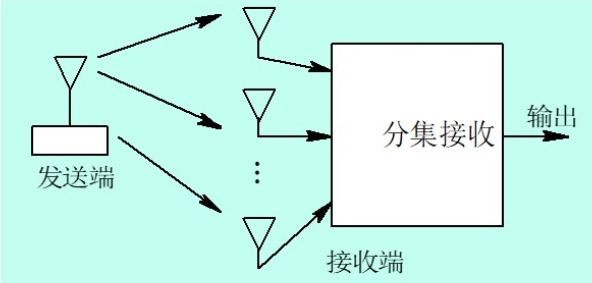

2024/4/11 19:44:33恒参信道特性及其对信号传输的影响

本专栏包含信息论与编码的核心知识,按知识点组织,可作为教学或学习的参考。markdown版本已归档至【Github仓库:https://github.com/timerring/information-theory 】或者【AIShareLab】回复 信息论 获取。 文章目录 恒参信道特性及其对信号传…

信息论随笔(三)交互信息量

之前讨论了一个事件的自信息量,但是实际情况下往往有多个事件发生,而且这些事件之间相互是有联系的。比如知道一个人踢足球,那么这个人很有可能会看世界杯。也就是说,我们可以通过一个事件获得另外一个事件的信息,或者…

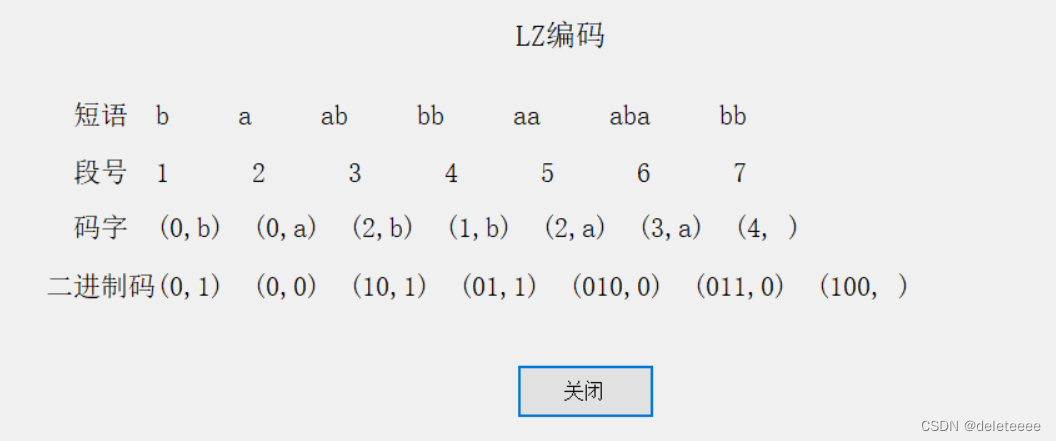

Visual Studio 2010+C#实现信源编码

1. 要求

本文设计了一套界面系统,该系统能够实现以下功能:

克劳夫特不等式的计算,并且能够根据计算结果给出相应的信息。可通过用户输入的初始条件然后给出哈夫曼编码以及LZ编码,结果均通过对话框来显示哈夫曼编码结果包含相应的…

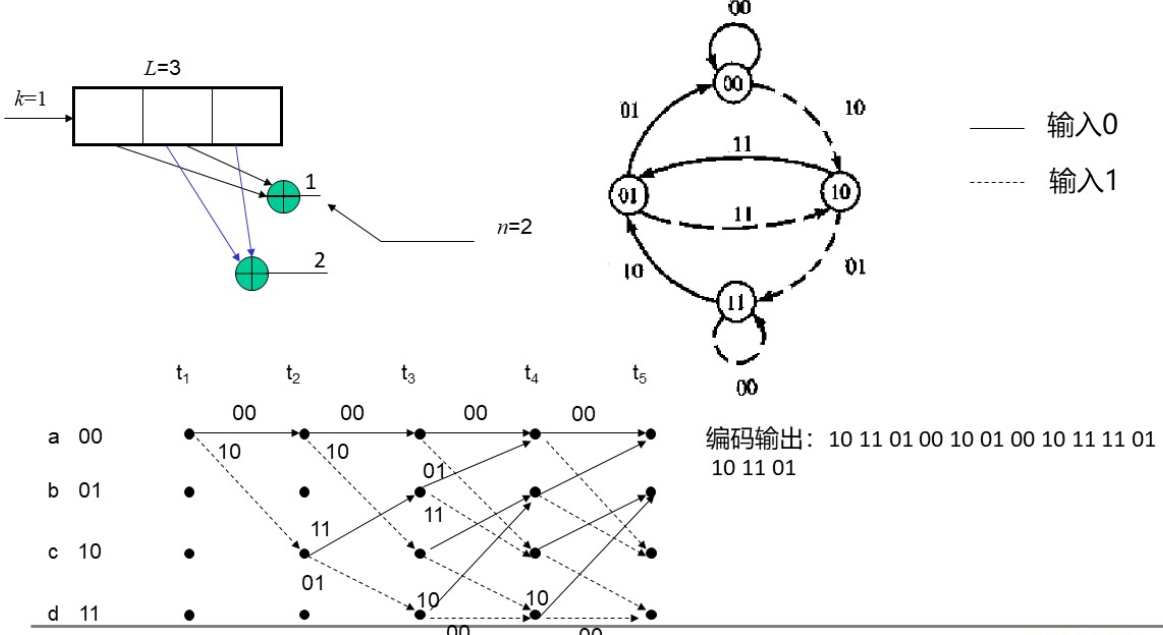

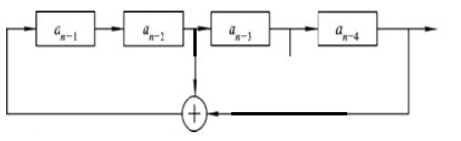

卷积码编码器的结构与表示

本专栏包含信息论与编码的核心知识,按知识点组织,可作为教学或学习的参考。markdown版本已归档至【Github仓库:https://github.com/timerring/information-theory 】或者公众号【AIShareLab】回复 信息论 获取。 文章目录 卷积码基础卷积码的…

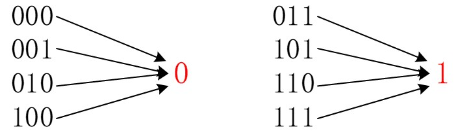

信息论复习—信源编码的基本方法

目录 信源编码的目的:提高传输效率

离散信源:

离散信源的分类:

离散无记忆信源 (DMS: Discrete Memoryless Source):

离散无记忆信源的特点:

离散无记忆信源编码与译码:

等长编码的编码速…

信息论与编码期末复习——概念论述简答题(一)

个人名片: 🦁作者简介:一名喜欢分享和记录学习的在校大学生 🐯个人主页:妄北y 🐧个人QQ:2061314755 🐻个人邮箱:2061314755qq.com 🦉个人WeChat:V…

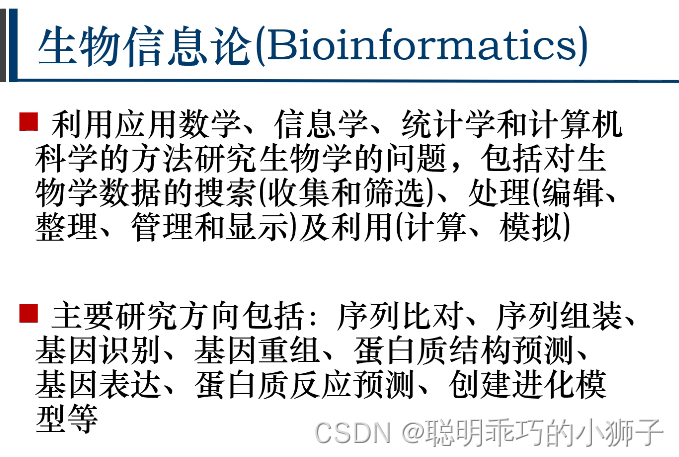

文章阅读-自动化领域论文选读

文章阅读-自动化领域论文选读 1. Optimal Deceptive Strategy Synthesis for Autonomous Systems under Asymmetric Information2. Sensor deception attacks against security in supervisory control systems3. Finite-time integral control for a class of nonlinear plana…

【概率基础】生成式模型与判别式模型最大的区别是什么?两者可以互相转化吗?

1. 生成式模型与判别式模型最大的区别

生成式模型与判别式模型最大的区别在于它们对数据的建模方式和目标。 建模方式: 生成式模型(Generative models)尝试学习输入数据和输出标签的联合概率分布 P ( X , Y ) P(X, Y) P(X,Y)。它关注于如何根…

信息论与编码期末复习——计算题+基础汇总(二)

个人名片: 🦁作者简介:一名喜欢分享和记录学习的在校大学生 🐯个人主页:妄北y 🐧个人QQ:2061314755 🐻个人邮箱:2061314755qq.com 🦉个人WeChat:V…

【AI】数学基础——信息论

不确定性才是客观世界的本质属性。不确定性的世界只能使用概率模型来描述,正是对概率模型的刻画促成了信息论的的诞生

香农——通信的数学理论,给定了对信息这一定性概念的定量分析方法

信息论在世界的不确定性和消息的可测量性之间搭建桥梁

条件熵和…

Renyi散度:Renyi divergence

有关Renyi散度的基本介绍挺多博客已经写了。本文章主要介绍最基础的概念,以及近些年论文中为啥老喜欢引用这个概念。

一.基础概念

Renyi散度主要是描述两个分布之间的关系。对一个离散的概率分布X,其定义域记作,其实就是概率不为零的点的集…

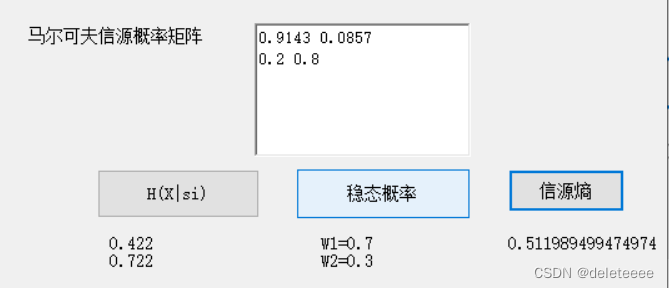

Visual Studio 2010+C#实现信源和信息熵

1. 设计要求

以图形界面的方式设计一套程序,该程序可以实现以下功能:

从输入框输入单个或多个概率,然后使用者可以通过相关按钮的点击求解相应的对数,自信息以及信息熵程序要能够实现马尔可夫信源转移概率矩阵的输入并且可以计算…

信息论、通信入门介绍

信源:产生消息和消息序列的来源 信道:传输的媒介 信宿:接受消息的人或机器 概率越小,信息量越大;概率越大,接近于1,那么信息量会趋于0,也就是信息量越小。 一个事件的信息量就是这个…

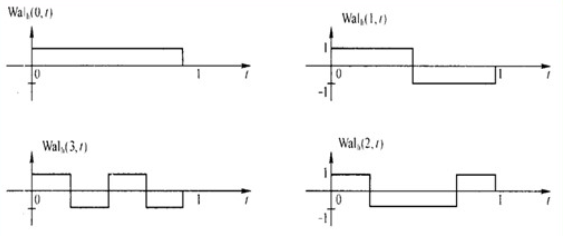

正交编码与正交沃尔什函数详解

本专栏包含信息论与编码的核心知识,按知识点组织,可作为教学或学习的参考。markdown版本已归档至【Github仓库:https://github.com/timerring/information-theory 】或者公众号【AIShareLab】回复 信息论 获取。 文章目录 正交编码正交编码的…

信道容量的数值解法(非对称信道)

from scipy.optimize import minimize

import numpy as np

import math"""[0.5,0.3,0.2]

求解信道传递矩阵为P(Y|X)[0.3,0.5,0.2]的非对称信道的信道容量C[0.1,0.2,0.7]

--------------------------------------------------------[0.5,0.3,0.2]

P(Y)P(X)P(Y|X)…

与信息熵相关的概念梳理(条件熵/互信息/相对熵/交叉熵)

香农信息量

信息量表示不确定性的大小。 信息量的单位是比特(bit)。 香农信息量log1p−logp(以2为底)香农信息量\log\frac{1}{p}-\log p\quad(以2为底)香农信息量logp1−logp(以2为底)

上式中,p越小,则不确定性越大&#…

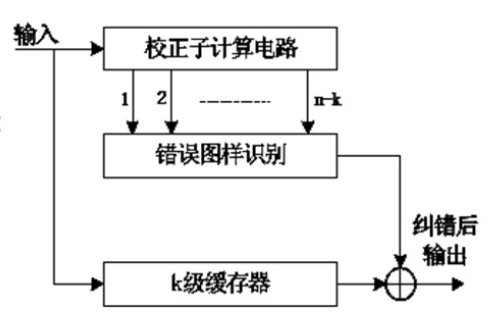

循环码的编码、译码与循环冗余校验

本专栏包含信息论与编码的核心知识,按知识点组织,可作为教学或学习的参考。markdown版本已归档至【Github仓库:https://github.com/timerring/information-theory 】或者公众号【AIShareLab】回复 信息论 获取。 文章目录 循环码的编码循环码…